Te recomiendo disfrutar del episodio 550 del podcast Coffee Break: Señal y Ruido [iVoox A, iVoox B; ApplePod A, ApplePod B], titulado “Entrevista DeepMind; AlphaGo y AlphaFold; Egipto; Consciencia”, 19 mar 2026. «La tertulia semanal en la que repasamos las últimas noticias de la actualidad científica. Cara A: Acast, nuevo partner de CB:SyR (5:00). Evento cientófilo para ver el eclipse del 12 de Agosto (6:00). Entrevista 10 años de DeepMind: Pushmeet Kohli y Thore Graepel (13:00). Cara B: Compuestos volátiles revelan la composición de los materiales para embalsamamiento en el antiguo Egipto (47:45). Teorías de la consciencia (1:18:45). Señales de los oyentes (1:42:15). Imagen de portada de Héctor Socas Navarro. Todos los comentarios vertidos durante la tertulia representan únicamente la opinión de quien los hace… y a veces ni eso».

¿Quieres patrocinar nuestro podcast como mecenas? «Coffee Break: Señal y Ruido es la tertulia semanal en la que nos leemos los papers para que usted no tenga que hacerlo. Sírvete un café y acompáñanos en nuestra tertulia». Si quieres ser mecenas de nuestro podcast, puedes invitarnos a un café al mes, un desayuno con café y tostada al mes, o a un almuerzo completo, con su primer plato, segundo plato, café y postre… todo sano, eso sí. Si quieres ser mecenas de nuestro podcast visita nuestro Patreon (https://www.patreon.com/user?u=93496937). También puedes apoyarnos vía iVoox (https://www.ivoox.com/support/172891). Muchas gracias a todas las personas que nos apoyan. Recuerda, el mecenazgo nos permitirá hacer locuras cientófilas. Si disfrutas de nuestro podcast y te apetece contribuir… ¡Muchísimas gracias!

Descargar el episodio 550 cara A en iVoox.

Descargar el episodio 550 cara B en iVoox.

Descargar el Bonus Audio (V.O. en inglés). Entrevista Pushmeet Kohli y Thorne Graepel.

Como muestra el vídeo participan por videoconferencia Héctor Socas Navarro @HSocasNavarro /@hectorsocas.bsky.social / @HSocasNavarro@bird (@pCoffeeBreak / @pCoffeeBreak.bsky), María Ribes Lafoz @Neferchitty / @Neferchitty.bsky / @neferchitty@mastodon, Luisa Achaerandio @LuiAcha / @LuiAcha.bsky (solo cara B), Alberto Aparici @CienciaBrujula / @CienciaBrujula.bsky, Juan Carlos Gil Montoro @ApuntesCiencia / @ApuntesCiencia.bsky / @ApuntesCiencia@astrodon, Ignacio Crespo @SdeStendhal, y Francis Villatoro @eMuleNews / @eMuleNews.bsky / @eMuleNews@mathstodon. Por cierto, agradezco a Manu Pombrol @ManuPombrol el diseño de mi fondo para Zoom; muchas gracias, Manu.

Tras la presentación, Héctor comenta un nuevo acuerdo (partnership) con Acast para este podcast CB:SyR (https://www.acast.com). Ya está cerrado el periodo de incrip las inscricl evento cientófilo para ver el eclipse del 12 de agosto que organiza Alicia Hurtado en Medinaceli (Soria)(contacto por Whatsapp). Alicia ha creado un canal de Whatsapp sobre esta quedada. Hay opciones con y sin alojamiento. Más detalles en el canal de Whatsapp.

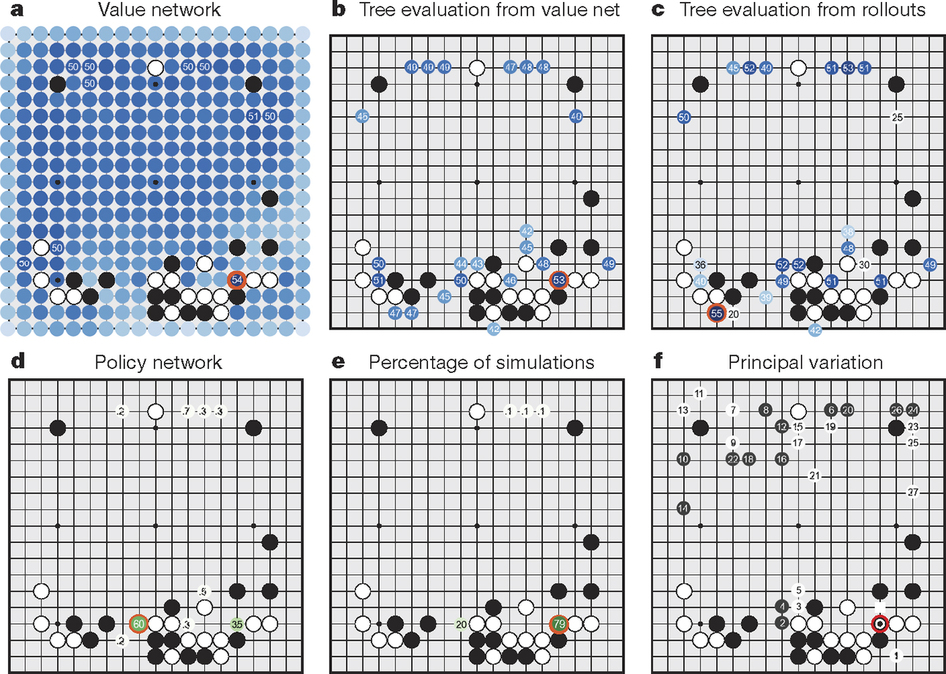

Héctor nos presenta la entrevista a Pushmeet Kohli y Thore Graepel por los 10 años de AlphaGo de DeepMind. Les entrevistan en inglés María, Alberto y Juan Carlos, siendo doblado al español mediante una IA, ElevenLabs (que imita las voces de los contertulios). Nos cuenta Héctor que la IA ha sido una gran ayuda y la calidad resultante es aceptable (aunque mejorable). Hace diez años ya te conté la partida entre AlphaGo y Lee Sedol: «Paliza de AlphaGO a Lee Sedol en el primera partida», LCMF; 09 mar 2016; «Nueva paliza de AlphaGo a Lee Sedol en la segunda partida», LCMF, 10 mar 2016; «Lee Sedol vence a AlphaGo en la cuarta partida», LCMF, 13 mar 2016; «Las consecuencias en IA del torneo AlphaGo vs Lee Sedol (4-1)», LCMF, 15 mar 2016; así como «Detalles técnicos de AlphaGo de Google DeepMind», LCMF, 18 mar 2016.

Alberto nos explica cómo se juega al go (un juego de rodear territorio). Y nos explica la famosa jugada 37 de la segunda partida, donde AlphaGo ocupó la quinta fila, cuando Sedol estaba jugando en la cuarta fila. Para un humano esto era un «error», una jugada que un humano no haría por sabiduría popular. Pero lo que estaba haciendo AlphaGo era jugar hacia el centro y hacer una jugada de tablero completo. Por cierto, Sedol estuvo unos 12 minutos pensando qué hacer tras la jugada 37. Juan Carlos nos presenta a los dos entrevistados. El alemán Graepel era jugador de go en el equipo de DeepMind y el indio Kohli no estaba entonces en DeepMind, pero hoy en día es vicepresidente de investigación en IA para asuntos científicos en DeepMind, siendo uno de los padres de AlphaFold.

AlphaGo consiguió un hito en el juego del Go una década antes de lo que muchos expertos creían posible (pues se estima que tiene 10¹⁷⁰ posiciones posibles en el tablero, muchas más que átomos en el universo observable). Se considera el inicio de la era moderna de la inteligencia artificial. Con una sola jugada creativa, la famosa jugada 37 de la segunda partida, AlphaGo sorprendío a todos los comentaristas profesionales que pensaron que era un error, pero resultó ser decisiva. Unos cien movimientos después, la piedra estaba en la posición exacta para que AlphaGo ganara la partida. Fue una demostración de que la IA puede ir más allá de los expertos humanos y desvelar estrategias nuevas.

Tras AlphaGo llegó AlphaGo Zero, que aprendió el juego a partir de partidas aleatorias y se convirtió en el jugador más fuerte de la historia. Y más tarde, AlphaZero aprendió por sí mismo desde cero a dominar cualquier juego de dos jugadores con información perfecta, incluyendo Go, ajedrez y shogi. Sin ningún conocimiento previo más allá de las reglas del juego, AlphaZero fue capaz de aprender a dominar el ajedrez en cuestión de horas y vencer no solo a los mejores jugadores humanos, sino también a los mejores programas especializados de ajedrez de la época, como Stockfish. AlphaZero fue capaz de idear nuevas e interesantes estrategias. Todo ello demostró que la tecnología estaba lista para aplicarse a un objetivo real, acelerar los avances científicos.

En 2020, AlphaFold 2 feu capaz de estrimar la estructura tridimensional de las 200 millones de proteínas conocidas por la ciencia (más de 3 millones de investigadores en todo el mundo usan la base de datos AlphaFold para acelerar su trabajo). En 2024, John Jumper y Demis Hassabis recibieron el Premio Nobel de Química por liderar dicho proyecto. DeepMind ha desarrollado AlphaProof, para desarrollar demostraciones matemáticas, y AlphaGeometry 2, para resolver problemas de la Olimpiada Internacional de Matemáticas (IMO). Gemini, tiene una versión avanzada llamada Deep Think capaz de resolver todos los problemas de la OMI 2025. AlphaEvolve explora el espacio de todos los programas informáticos para descubrir algoritmos más eficientes. Y mucho más… La jugada 37 fue el indicio de que la ciencia del futuro ya no se podría concebir sin la asistencia de las IA generativas. Nos lo cuenta Demis Hassabis, «From games to biology and beyond: 10 years of AlphaGo’s impact,» DeepMind, 10 Mar 2026.

María nos cuenta un artículo que muestra cómo los compuestos volátiles revelan la composición de los materiales para embalsamamiento en el antiguo Egipto. El olor característico de las momias egipcias no procede solo de la degradación post mortem, sino también de los compuestos orgánicos volátiles (VOCs) retenidos durante milenios en bálsamos, vendajes y tejidos. Gracias a ello se propone explorar esa fracción volátil para averiguar si conserva una firma química para discriminar materiales de embalsamamiento y cambios cronológicos. Se analizaron 35 muestras de 19 momias, incluyendo 14 tejidos, 13 vendajes, 2 huesos y 6 materiales resinosos, con cronologías que abarcan desde fases antiguas de la momificación egipcia hasta periodos tardíos/grecorromanos.

Héctor nos explica cómo funciona la espectrometría de masas por cromatografía de gases por tiempo de vuelo (GC/Q-TOFMS, por gas chromatography/quadruple time-of-flight mass spectrometer); esta es uan de las técnicas no invasivas que se usan en el artículo. Y María continúa contando el artículo. Los resultados se centran en tres hipótesis: (1) distintas composiciones del bálsamo producen perfiles VOC característicos; (2) las momias de distintos periodos históricos presentan perfiles volátiles diferentes; y (3) también influyen el tipo de muestra y la localización anatómica. Usando diferentes metodologías bioquímicas (biomarcadores lipídicos, cromatografía de gases y espectrometría de masas, entre otras). Los resultados muestran que la fracción volátil refleja la composición del material de embalsamamiento: las muestras dominadas por grasas y aceites muestran ácidos grasos de cadena corta y compuestos aromáticos; la cera de abeja aporta, además, ácidos monocarboxílicos, n-alcanos y compuestos benzoicos/cinámicos; las resinas coníferas se asocian a aromáticos y sesquiterpenoides; y el bitumen queda marcado por compuestos naftalénicos, con naftaleno como señal dominante en los cromatogramas con bitumen.

El análisis multivariante confirma que el factor más influyente sobre el perfil global es la fecha de la muestra, seguido por la composición del bálsamo; también son significativos la presencia de bitumen y el tipo de muestra. En las muestras 100 % fat/oil, compuestos como alcanfor, fenantreno, 18-norabietano y 2-decenal (aldehído alifático insaturado de 10 átomos de carbono) discriminan por edad y tipo de muestra; y en el caso del bitumen, incluso cantidades bajas alteran de forma notable el perfil volátil. En suma, el artículo propone los VOCs como una herramienta rápida, sensible, no destructiva y preliminar para inferir composición del bálsamo e incluso aportar información cronológica sobre momias egipcias. El artículo es Wanyue Zhao, Katherine A. Clark, …, Ian D. Bull, «Volatile compounds reveal the composition of embalming materials used in Egyptian mummification,» Journal of Archaeological Science 187: 106490 (22 Jan 2026), doi: https://doi.org/10.1016/j.jas.2026.106490.

Ignacio nos sigue contando teorías de la consciencia. HOT (Higher-Order Theories). Sostiene que una representación de primer orden del mundo no basta para experiencia consciente, hace falta una representación de orden superior (metarrepresentación) que “apunte” o rerrepresente el estado de primer orden (por ejemplo, monitorizando su precisión/fiabilidad), conectando la fenomenología con mecanismos de metacognición (a menudo asociados a circuitos prefrontales/parietales). El artículo subraya que hay variantes “lean” vs “rich” y debates sobre (mis)representación, y que es crucial controlar el rendimiento para no confundir cambios de desempeño con cambios de conciencia.

Esta teoría es una de las más difíciles de explicar con claridad, quizá porque arrastra una ambigüedad intrínseca considerable. A menudo se la relaciona con la metacognición, es decir, con la capacidad de reflexionar sobre otros procesos cognitivos y de monitorizarlos. En el laboratorio, la metacognición suele estudiarse pidiendo a los participantes que evalúen su grado de confianza o la probabilidad de error en su propio desempeño; en tareas perceptivas, esto se conoce como confianza perceptiva. Desde esta perspectiva, las HOT ofrecen un marco útil para investigar experimentalmente la base neural de esa confianza y su posible relación con la experiencia consciente.

Ignacio menciona también el caso de los pacientes sometidos a callosotomía, en los que a veces parece asomar algo parecido a dos corrientes de conciencia relativamente separadas. Recuerda, por ejemplo, los experimentos asociados a Gazzaniga, en los que una imagen erótica presentada al hemisferio derecho provocaba la risa del paciente, aunque ese hemisferio no pudiera comunicar verbalmente lo que había visto. Esto abre una pregunta sugerente: ¿podrían existir subestructuras cerebrales capaces de albergar experiencias conscientes mínimas, pequeñas islas de conciencia, aunque no puedan reportarlas ni integrarlas en un relato verbal? Héctor formula entonces un contraargumento, casi en tono cínico: si esa idea es seria, habría que poder implementarla en un sistema software. Para él, la experiencia consciente requeriría un umbral suficiente de complejidad. Ignacio, sin embargo, subraya que también hay argumentos en sentido contrario, según los cuales no haría falta una complejidad excesiva para que aparezcan formas mínimas de experiencia.

El artículo que nos presenta sigue siendo Liad Mudrik, Melanie Boly, …, Lucia Melloni, «Unpacking the complexities of consciousness: Theories and reflections,» Neuroscience & Biobehavioral Reviews 170: 106053 (Mar 2025), doi: https://doi.org/10.1016/j.neubiorev.2025.106053.

Y pasamos a Señales de los Oyentes. @AlyCia_hanHurtadoelEspín pregunta: «¿Qué tal están funcionando las IA para las «Cannabis-Yau»? XD». Contessto que se están usando técnicas de inteligencia artificial y de aprendizaje profundo para explorar el espacio de todas las variedades de Calabi–Yau en busca de una que describe con todo detalle el modelo estándar (pero aún no se ha encontrado). Recomiendo leer a Charlie Wood, «AI Starts to Sift Through String Theory’s Near-Endless Possibilities,» Quanta Magazine, 23 Apr 2024.

@javierbenavides2669 pregunta: «¿Es cierto eso de que el lenguaje nativo implica zonas del cerebro diferentes a los idiomas aprendidos?» Ignacio responde que puede haber regiones que se solapen, pero que no conocemos ese reparto con un nivel de detalle tan específico. Añade que, en animales, se han realizado experimentos de reorganización sensorial, por ejemplo, redirigiendo ciertas entradas hacia otras áreas corticales, lo que sugiere una plasticidad notable, aunque eso no permite trasladar de forma simple esa idea al caso del lenguaje humano.

La respuesta breve es que sí puede haber diferencias, pero no en el sentido fuerte y simplista de que “la lengua materna está en una zona” y “los idiomas aprendidos en otra”. La visión actual es que la lengua materna (L1) y la segunda lengua (L2) comparten en gran medida la misma red cerebral del lenguaje. Lo que suele cambiar no es tanto la localización básica como el grado de activación de determinadas regiones y la necesidad de reclutar recursos adicionales según la tarea. En conjunto, la evidencia apunta a que la idea de que L1 y L2 deban representarse necesariamente en zonas distintas no está confirmada.

La afirmación de que “están en zonas diferentes” procede sobre todo de un estudio clásico de resonancia magnética funcional (fMRI) de 1997. Ese trabajo sugirió que, en bilingües tardíos, podía existir cierta separación dentro del área de Broca entre la lengua nativa y la segunda lengua, mientras que en el área de Wernicke esa separación era pequeña o inexistente; en bilingües tempranos, en cambio, ambas lenguas tendían a compartir las mismas áreas frontales. Fue un resultado muy influyente, pero con el tiempo se ha visto que no puede generalizarse sin muchos matices.

Lo que hoy parece más sólido es lo siguiente: cuanto más temprana es la adquisición de la L2 y mayor es su dominio, más se asemeja su patrón cerebral al de la L1. Cuando la segunda lengua se aprende más tarde o se domina peor, suele activarse una red más amplia, con mayor participación de áreas relacionadas con el control ejecutivo y la monitorización. No sería tanto que exista un “segundo cerebro del lenguaje”, sino que la tarea exige más esfuerzo de selección, inhibición y control.

Además, el aprendizaje y el uso continuado de una segunda lengua no solo modifican la activación funcional, sino que también pueden asociarse a cambios estructurales medibles en el cerebro. Por tanto, la formulación más correcta sería esta: no existe una regla simple del tipo “lengua materna = zonas A, idioma aprendido = zonas B”; más bien hay una red ampliamente compartida, sobre la que influyen factores como la edad de adquisición, la fluidez alcanzada, la frecuencia de uso, la modalidad y el tipo de tarea realizada.

Lo que hoy parece más sólido es esto: cuanto más temprana es la adquisición de la L2 y mayor es la competencia, más se parece su patrón cerebral al de la L1. Cuando la L2 se aprende más tarde o se domina peor, suele aparecer una red más amplia, con mayor reclutamiento de áreas de control ejecutivo y monitorización, no tanto porque exista un “segundo cerebro del lenguaje”, sino porque la tarea exige más esfuerzo de selección, inhibición y control. Meta-análisis y estudios en bilingües de alta competencia apuntan justamente en esa dirección.

Además, aprender y usar una segunda lengua no solo cambia la activación funcional: también puede asociarse a cambios estructurales medibles, por ejemplo en la corteza parietal inferior izquierda, y esos cambios dependen de la edad de adquisición y la destreza alcanzada. Así que la respuesta correcta sería: no, no hay una regla simple de “lengua materna = zonas A, idioma aprendido = zonas B”; hay una red compartida, sobre la que influyen la edad, la fluidez, el uso cotidiano, la modalidad y el tipo de tarea.

@gabrielosorio595 pregunta: «Respecto al habla y los orígenes, ¿qué fue primero el arco o la lira? [¿El arte o la guerra?]». Contesta María que no es una pregunta fácil de contestar. Ignacio añade que todo depende, en buena medida, de cómo definamos “guerra” y “arte”, y subraya que conviene abordarlo desde una perspectiva gradualista y atenta a la noción de agencia. Incluso en animales, por ejemplo, en algunos artrópodos, observamos conductas que recuerdan de forma vaga a formas primitivas de guerra, mientras que en otros casos son capaces de «dibujar» lo que evocan a algo parecido a un mandala, que podría verse como un antecedente remoto de lo artístico. Por eso, la distinción no es nítida. Aun así, su impresión es que, en un sentido evolutivo muy amplio, la guerra fue antes que el arte.

@ThomasEmilioVilla pregunta: «¿Es verdad que no hay mención de eclipses solares en la literatura del antiguo Egipto? ¿Es que no conocían el ciclo de Saros o lo conocían pero era una amenaza para Amon-Ra? :)» Alberto responde que entrevistó a un historiador quien le comentó que, al parecer, existía un cierto tabú cultural en torno a los eclipses: no se hablaba de ellos de forma directa, sino mediante eufemismos o metáforas, de modo que sí habría un trasfondo religioso.

Héctor añade que las menciones a eclipses conservadas son escasas y, además, indirectas. Comenta que tiende a pensar que los egipcios no conocían el ciclo de Saros en un sentido astronómico preciso. Ignacio señala que, en la cosmovisión egipcia, Ra muere cada día y vuelve a surgir, pero Alberto subraya que eso forma parte del orden natural: no equivale a la irrupción repentina de un fenómeno aleatorio que rompe ese orden e introduce el caos. Ignacio recuerda, sin embargo, que en la Antigüedad existían ritos precisamente vinculados al caos, lo que complica una interpretación demasiado simple.

Alberto insiste también en que no es lo mismo conocer la existencia de los eclipses que conocer su periodicidad y, en particular, el ciclo de Saros. En el caso egipcio, buena parte de lo que conservamos procede del contexto funerario, y no sería esperable encontrar en las tumbas referencias explícitas a fenómenos como los eclipses. Héctor advierte además contra el error de suponer una homogeneidad cultural excesiva: no tiene sentido hablar de “los egipcios” como si todos compartieran exactamente las mismas creencias, conocimientos o actitudes ante estos fenómenos.

@ThomasEmilioVilla pregunta: «Entre humanos en teoria de juegos hay equilibrios de Nash suboptimales. ¿Lo mismo pasaría entre AlphaGo jugando o no percebiría ese aspecto de mors tua vita mea?» Hay que recordar que un equilibrio de Nash subóptimo es una situación estable en la que nadie tiene incentivo individual para cambiar de estrategia, aunque el resultado conjunto no sea el mejor posible. Eso ocurre sobre todo en juegos que no son de suma cero, donde puede haber conflicto de intereses, pero también posibilidades de cooperación parcial o de ineficiencia colectiva.

En ese sentido, no conviene mezclarlo con el caso de AlphaGo. El go, idealizado como juego de dos jugadores, es un juego de suma cero, lo que gana uno lo pierde el otro. Ahí no aparece un problema del tipo mors tua vita mea como “aspecto oculto” que deba ser percibido; ese antagonismo está ya incorporado en la propia estructura del juego. AlphaGo no “descubre” una dimensión moral o social del conflicto, sino que optimiza su actuación dentro de un marco competitivo.

Héctor señala que aquí se están cruzando dos ideas distintas. Nash es célebre por estudiar juegos más generales que los de suma cero, mientras que la oposición radical de intereses, del tipo mors tua vita mea, encaja mejor con los juegos de suma cero. Por eso, si se quiere hablar de equilibrios de Nash subóptimos entre humanos, el ejemplo adecuado no sería el go, sino más bien juegos de coordinación fallida, dilemas sociales o situaciones en las que la racionalidad individual conduce a un resultado colectivo peor.

¡Que disfrutes del podcast!

Estaba jugando con matrices para la teoría de juegos, y se me ocurrió que muchas situaciones serían mejor de modelizar, quizá empleando toda la potencia de los tensores, donde algunas opciones covarían o contravariarían según los beneficios o las desventajas que alguien tenga según su ‘métrica’ (su perspectiva). Supongo que se podría explicar así muchos comportamientos sociales que desde fuera parecen ‘suicidas’ o idiotas, que sin embargo pueden tener alguna explicación —que no es justificación— entendiendo la base en la que se miden las opciones… Quizá podría emplearse para modelizar, por ejemplo, de forma eficaz los bulos y la desinformación, ¿no? A lo mejor sería beneficioso para las ciencias sociales..

Thomas, no entiendo la idea detrás de «opciones covarían o contravarían». En teoría de juegos, las matrices aparecen en juegos entre dos agentes, con las filas representando las opciones de juego de un agente, y las columnas las del otro agente; para juegos con múltples pasos el álgebra matricial ayuda a calcular. Como es obvio, si hay tres o más agentes, el objeto natural es el tensor y para múltiples pasos el álgebra tensorial. Pero la co- o contra-variancia, es decir, la diferencia entre vectores y aplicaciones lineales (1-formas o covectores) no me parece que describa nada relevante en teoría de juegos.

Muy buena observación. Claro: para modelizar matemáticamente lo que ocurre con las fake news necesitamos varios agentes, cada uno con una función de payoff bien definida, y una estructura temporal de varios pasos. Un toy model muy simple podría considerar como jugadores: 1) los informadores o supuestos insiders, cuyo principal recurso estratégico sería un cierto capital reputacional ligado a haber sido en el pasado exfuncionarios de alguna organización de renombre; 2) los medios de información, cuyo payoff combinaría la credibilidad de las noticias publicadas con la posibilidad de ganar audiencia y lectores para atraer espacio publicitario; 3) los lectores o espectadores, que deciden si comprar o no ciertos medios o si ver o no determinados programas, y cuyo payoff incluye también un factor psicológico importante: la gratificación de sentirse ‘especiales’, como si fueran de los pocos que han comprendido cómo funcionan realmente las cosas, en oposición a la llamada ‘ciencia oficial’; y 4) las autoridades, cuyo interés consistiría en no dañar excesivamente la economía vinculada al ecosistema informativo y al mercado publicitario, pero tampoco permitir un grado de desinformación que termine degradando la calidad del debate público y de la democracia.

Ahora bien, en este marco parece razonable distinguir entre capitales de credibilidad de largo plazo, difíciles de reconstruir y esenciales para el funcionamiento democrático, y capitales sacrificables o monetizables, que pueden transformarse en beneficios inmediatos. Por eso, quizá más que hablar de covariancia y contravariancia en sentido tensorial, convendría modelizar la tensión entre intereses globales o estructurales, por un lado, e intereses temporales o locales, por otro. En concreto, habría que introducir variables como la credibilidad del difusor, la propensión del público a creer, el incentivo a divulgar una noticia no verificada, el nivel de sensacionalismo y la fuerza y eficacia del fact-checking. La evolución del sistema podría estudiarse mediante una dinámica iterada y su linealización local, utilizando el Jacobiano para analizar cómo pequeñas perturbaciones se amplifican o se amortiguan en el estado informativo; por ejemplo, comparando el efecto de una fake news emitida por una fuente sin capital previo de credibilidad con el de una difundida por una fuente que sí dispone de ese capital reputacional.

madre mia, perdona el epitafio, ignoralo que es demasiado largo y perdoname ajajja!

Pido perdón, pero sigo sin entender qué tienen que ver la covariancia y la contravariancia con un modelo de teoría de juegos de los agentes implicados en las noticias falsas (fake news). Se han publicado muchos modelos basados en teoría de juegos para la desinformación en redes sociales; las técnicas estándares de teoría de juegos se usan con éxito sin necesidad de ninguna «floritura exótica».

Pues eso, fue una ida de olla importante. Perdón. Las ideas realmente buenas se expresan en pocas líneas; si necesitas mucho espacio, es que no aportan nada interesante. Un simple juego matemático sin aplicaciones 🙂

Thomas. Lo que estás intentando, matematizar comportamientos sociales, tiene una dificultad básica (más allá de la obvia respecto a la cantidad de factores que entran en juego) y es comprender primero por qué elementos individuales, en principio no predecibles siquiera estadísticamente, en conjunto, producen comportamientos muy predecibles.

Quién resuelva eso, tendrá la primera piedra.

«El humano va a buscar ciertas correlaciones y esas correlaciones son triviales de entender. Entonces, la máquina puede entender no solo las correlaciones que entiende un humano después de haber jugado pues unas decenas de miles de partidas en su vida y además correlaciones que un humano no puede llegar a a observar porque la máquina puede aprender, puede jugar decenas de millones de de partidas. Entonces, aprende en dos o tres días decenas de millones de partidas y observa correlaciones más allá de las correlaciones que observan los humanos. Pero el punto clave es que son correlaciones triviales que están obvias en los datos cuando los ves eh en toda su dimensión.»

¿En qué quedamos?.

¿El cerebro humano aprende de la misma forma que las redes neuronales artificiales?.

¿Imitar el entendimiento a partir de correlaciones estadísticas es lo mismo que entender?.

¿Imitar el habla (pensamiento) es lo mismo que hablar (pensar)?.

NO.

«Lo único que tienes que hacer es aprender correlaciones entre datos y los datos es leer muchos textos, tener muchos tokens y cuanto más tokens tienes, cuanto más información tienes aprendida y eso sí, no sobreaprendida, porque como sobreaprendas peor todavía tienes que aprender en muy poquitas épocas, tienes que aprender de manera muy suave pero mucho, con una red neuronal suficientemente grande para que tenga un tamaño similar al conjunto de tokens. Y eso era romper completamente todo lo que se sabía de inteligencia artificial. Y cuando se hizo eso, se descubrió que el lenguaje natural es trivial.»

La disciplina de la inteligencia artificial no ha descubierto que el lenguaje natural es trivial. Ha descubierto que imitar el lenguaje natural mediante correlaciones estadísticas a partir de muchísimos datos es posible. Nada más. Los niños tampoco aprenden a hablar así. Un idioma no es lo mismo que la lingüística. Y los niños no necesitan estudiarla para aprender a hablar, pero tampoco aprenden como se entrena un LLM. Y no es que la estructura gramatical ya esté inscrita de fábrica en sus cerebros, como enseguida quiere Ribes. La clave para la capacidad de aprendizaje de un idioma está, como señaló Crespo, está en el efecto Baldwin. Pero hay que entenderlo bien. No es asimilación genética de contenidos lingüísticos. Todos los contenidos lingüísticos (sintácticos, semánticos y pragmáticos) se adquieren mediante aprendizaje social. No son innatos. Pero se aprenden como el uso de cualquier herramienta. La única diferencia es que son herramientas comunicativas (y después, pero no menos, cognitivas).

Afirmar que un LLM realmente habla y entiende no es menos atrevido que afirmar que realmente le duele la cabeza cuando responde que le duele.

Me gusta como algunos autores lo verbalizan de la siguiente manera: «descubrimos que la comunicación humana no es tan especial como para no poder ser automatizada»

P, esa ha sido la gran revolución de los LLMs. La mayoría de los expertos en lingüística computacional opinaban que la comunicación humana no podía ser automatizada. Los LLMs descrubrieron que con una arquitectura adecuada y muchos pesos la comunicación humana es trivial de automatizar (basta un aprendizaje por exposición). Yo estudié procesamiento del lenguaje natural hace más de 35 años y entonces el problema parecía imposible; literalmente, imposible. Hoy ya está resuelto. También estudié que el go era un juego imposible de automatizar y muchas otras cosas que se decía que eran imposibles y que hoy son una realidad.

Si con automatizar nos referimos a imitar el resultado, no problem. Pero si nos referimos a realizar un proceso comunicativo, la cosa cambia. El significado del resultado depende de un observador que lo interpreta. Sin interpretación, solo hay manipulación formal. No hay intención comunicativa, ni entendimiento. Sin personas las calculadoras no calculan. El software determina cómo se mueven los electrones en los circuitos, no al revés. Y la intención del programador lo que determina cómo tiene que ser el algoritmo para que la salida cumpla su propósito. Otro tanto ocurre con las cabezas. El resultado consciente de la actividad neuronal solo es significativo para la persona que lo vive. Y esa actividad es como tiene que ser para que sea significativa (causación descendente). Como dice Kevin Mitchell, el significado consciente es la moneda de cambio de esa actividad neuronal.

P.D. Ya sé que la IA generativa no funciona como una calculadora, pero el ejemplo vale.

Tienes que percatarte, Maxgüel, sin llevarte la contraria, pues las IA argumentativas son meras herramientas, que la diferencia entre el algoritmo de toda la vida y el algoritmo que confirma la IA, una red neuronal, es que este último es un algoritmo de carácter universal.

Es decir, la diferencia entre los dos es como la diferencia entre una calculadora y una máquina de turing.

La combinación de maquina de turing y algoritmo universal, nos está dando resultados que nos sorprende y de ahí que nos veamos empequeñecidos, pero no sabemos si esa combinación será suficiente para convertirla en algo que entienda, sea consciente etc…

551.

«- He usado un cerebro de ratón.

– Si está congelado – advirtió el primer técnico -, no podremos ponerlo en el ordenador. Tendrá que ir a proa, en los depósitos de emergencia.

– Este cerebro no está congelado – replicó Tigabelas -. Ha sido laminado. Lo endurecimos con celuprime y luego lo cortamos en siete mil capas. Cada una está separada por un plástico de por lo menos dos espesores moleculares. El ratón no puede deteriorarse. En realidad, este ratón seguirá pensando para siempre. No pensará mucho, a menos que le apliquemos voltaje, pero pensará. Y no se puede deteriorar. Esto es plástico cerámico (…)

– ¿El ratón está muerto?.

– No. Sí. Claro que no. ¿Qué quiere usted decir?. Quién sabe. – soltó Tigabelas de una tirada.»

«Piensa azul, cuenta hasta dos.»- C. Smith (1963)

551.

A la habitación china le pasaba lo que al zombi filosófico. Era un argumento falaz para un tesis verdadera. Y digo «era» porque los actuales LLM han demostrado lo contrario. El experimento mental del zombi filosófico intentaba demostrar que la consciencia no es reducible a su sustrato biológico. Y es cierto que no lo es, pero es falaz que una copia idéntica de una persona pueda hacer lo que hace una persona consciente, sin serlo. Tanto la superveniencia como el argumento evolutivo (Jablonka) lo desmontan. La consciencia sirve para algo y sin ella no puede hacerse lo mismo que con ella (aunque quizás en el futuro la robótica haga al zombi lo que los LLM han hecho a la habitación china y también deje de ser una prueba falaz). El experimento de la habitación china intentaba demostrar que la semántica no es reducible a sintaxis. Y es cierto que no es reducible. Era falaz porque no era verosímil que una persona pudiese imitar de forma coherente el habla de un chino solo a partir de reglas de composición, sin entender chino. Un hablante nativo de chino se daría cuenta inmediatamente de la impostura. Pero ha dejado de ser una prueba falaz porque los actuales LLM han demostrado que sí es posible imitar el habla de un chino a partir de inferencia estadística y cantidades masivas de texto, sin entender chino. Es un resultado completamente inesperado, pero no invalida la prueba de la habitación, sino todo lo contrario. Un LLM sigue sin entender chino. Efectivamente, como señala Giribet, Searle quería mostrar la diferencia entre pasar el test de turing y entender el significado, entre la comprensión consciente de lo se dice y su imitación. No lo hizo bien pero resulta que al final sí lo hizo.

P.D. Socas acusa a Searle de buscar argumentos que confirmen su tesis, de poner el carro delante del caballo. Sería un ad hominem si no fuese porque todos lo hacemos. Pero la intención de Socas era denigrar a Searle. La viga en el ojo. Le acusa de pensamiento inercial cuando es él quien no concibe que uno de sus invitados le defienda y de entrada ya lo había colocado fuera del materialismo porque no acepta un funcionalismo computacional. De nuevo, con su mejor talante y bonhomía, vuelve a caer en el vicio de las posiciones dicotómicas.

Y conste que yo estoy de acuerdo con el antirreduccionismo de Searle, pero me parece que su materialismo es incoherente. Si la experiencia en primera persona implica diferencia ontológica, el materialismo es falso. Lo mismo le ocurre al de Bueno. Lo psicológico (M2) y lo eidético (M3) es material porque patatas.

Y no deja de ser irónica la adcripción que hacen en el programa del funcionalismo al materialismo, cuando tradicionalmente el funcionalismo ha sido acusado de dualista (software vs hardware). Un dualismo que algunos funcionalistas, hartos de defenderse de la acusación, reconocen y asumen como fundacional.

Más tabarra.

– Postular axiomas sobre las propiedades de la consciencia inspiradas en la fenomenología no convierte a la IIT en una teoría idealista. Crespo no ha justificado esa afirmación. Por otro lado, son axiomas muy razonables. Es su pretensión de cuantificar la consciencia analizando su estructura causal lo que me chirría.

– La actividad consciente durante el sueño REM no es menor que durante el sueño profundo no REM, sino al contrario. Se llama sueño paradójico precisamente porque el electroencefalograma muestra una actividad muy parecida a la vigilia. Y su contenido consciente no es menos «florido». La corteza sensorial y motora se activa de la misma manera y los escenarios oníricos nos regalan vivencias de una variedad que la vigilia no permite.

El problema de la filosofía, Maxgüel, es que siempre vas a poder ir moviendo Searle.

Todos sabemos que Searle hubiera encontrado pegas a que se pudiera hacer una IA tal cual funciona ahora.

Efectivamente se ha logrado que la IA traduzca super bien con contexto y le ha dado la razón al nuevo Searle, pues el antiguo estaba pensando en algoritmos específicos. Pero lo podemos ver al revés también, porque la IA está «mojando», es decir, como la simulación de la lluvia que en realidad no moja, la IA está entrando e impactando.

Los LLM han resultado simulaciones mucho más convincentes. Nada más. Lo que hacen sigue siendo algo muy distinto a lo que hace una persona cuando comprende. Sigue siendo acertar por fuerza bruta, no por comprensión. El agua simulada no moja ni mojará nunca, por mucho que nos enchufemos la VR en el cogote y sintamos las gotitas en la piel. Lo relevante de la habitación china no es que antes era un experimento mental inverosímil y ya no lo es, sino la tesis que defiende: Que la simulación del entendimiento no es lo mismo que el entendimiento real. Eso era igual de válido antes que ahora. Asunto distinto es que a efectos prácticos no nos importe y acabemos dando barrigazos por los bares con un robot de compadre.

Off topic: Excelente (y larga) la charla que dio Carlos Madrid en la Fundación Gustavo Bueno sobre filosofía de la mecánica cuántica desde el materialismo filosófico. En mi opinión es mucho más un constructivismo que un materialismo y si no fuese por mi recalcitrante instrumentalismo, me pasaría a sus filas.

https://www.youtube.com/watch?v=AIhspT8TDOs

Off-topic: Buenos días Francis, leo que uno de los Premios Cozzarelli 2025, ha sido concedido a un trabajo realizado por 4 investigadores españoles: «The emergence of eukaryotes as an evolutionary algorithmic phase transition»

https://www.pnas.org/doi/10.1073/pnas.2422968122

¿Te parece lo suficientemente interesante para una entrada en este tu blog?

Gracias y saludos cordiales.

Albert, sobre este artículo me entrevistó Antonio Martínez Ron para “La vida dio un salto ‘imposible’: científicos españoles proponen que un cambio de “sistema operativo” sacudió la evolución. Enrique Muro, Fernando Ballesteros, Bartolo Luque y Jordi Bascompte han recibido el prestigioso Premio Cozzarelli de la Academia Nacional de Ciencias de EEUU por un innovador trabajo en el que sugieren que la aparición de las células eucariotas no fue un accidente evolutivo, sino la única solución algorítmica al límite de producción de proteínas”, ElDiario.es, 26 mar 2026. Mi crítica es que el adjetivo “algorítmica” no está justificado para la posible “transición de fase” observada en la distribución para la media de las longitudes de genes y proteínas. Luque usó el adjetivo en artículos de hace 15 años, sin justificación rigurosa, y vuelve a usarla aquí, sin ningún tipo de justificación. Las conclusiones no están apoyadas por los datos. No entiendo cómo le han dado este premio.

Muchas gracias por responder, saludos cordiales.