La noticia «Físicos españoles resuelven el problema de los infinitos en las 4 dimensiones de Einstein», El Confidencial, 05 Oct 2016, quizás te haya llamado la atención. No sé si habrás entendido la frase «se ha desarrollado un método que resuelve el problema de las dimensiones del espacio-tiempo en las teorías aplicadas al Gran Colisionador de Hadrones (LHC) y que permite mantener así las cuatro dimensiones que estableció Einstein». Junto al titular me parece poco acertada.

Tampoco sé si habrás llegado a leer el final de la noticia, donde pone «los infinitos que surgen en cuatro dimensiones aparecen entonces como contribuciones que dependen de la diferencia de dimensiones con respecto a cuatro, un «truco matemático» para modelar esos infinitos en pasos intermedios de los cálculos para obtener predicciones imposibles de obtener de otro modo. [Se] ha desarrollado un nuevo método que redefine la teoría evitando la aparición de infinitos, y que permite por tanto mantener la teoría en las cuatro dimensiones habituales del espacio-tiempo». Permíteme que te aclare un poco el asunto.

La noticia se hace eco del artículo de Germán F. R. Sborlini, Félix Driencourt-Mangin, …, Germán Rodrigo, «Four-dimensional unsubtraction from the loop-tree duality,» Journal of High Energy Physics 2016: 160 (29 Aug 2016), doi: 10.1007/JHEP08(2016)160; arXiv:1604.06699 [hep-ph]. También te recomiendo German F. R. Sborlini, Felix Driencourt-Mangin, German Rodrigo, «Four-dimensional unsubtraction with massive particles,» arXiv:1608.01584 [hep-ph], y R. J. Hernández-Pinto, F. Driencourt-Mangin, …, G. F. R. Sborlini, «NLO cross sections in 4 dimensions without DREG,» arXiv:1609.02454 [hep-ph].

La regularización dimensional es el método de renormalización más utilizado para realizar cálculos teóricos en cromodinámica cuántica necesarios para estudiar las colisiones protón contra protón en el LHC. El método fue descubierto de forma independiente por Bollini y Giambiagi (1972), ‘t Hooft y Veltman (1972), Ashmore (1972) y Cicuta y Montaldi (1972), pero fue popularizado por Gerardus ‘t Hooft y Martinus Veltman (galardonados con el premio Nobel de Física en 1999 por resultados en los que usaron dicho método). La versión actual más usada fue introducida por Breitenlohner y Maison (1977), por lo que a veces se llama método de regularización BMHV. Por cierto, en este blog puedes leer «Los dos argentinos que descubrieron hace 40 años cómo calcular en 4+ε dimensiones», LCMF, 11 Nov 2012.

Los diagramas de Feynman corresponden a integrales en cuatro dimensiones que presentan divergencias (polos en los que el integrando se vuelve infinito y el resultado de la integral también). Para evaluar estas integrales se pueden usar varias técnicas de regularización, que de diferentes modos esquivan los polos donde están los infinitos y obtienen un resultado finito. La regularización dimensional usa una idea muy popular entre los matemáticos a la hora de evaluar integrales de variable real usando técnicas de variable compleja, considerar que la variable real es en realidad compleja y esquivar los polos usando contornos de integración en el plano complejo que los rodean. En la regularización dimensional se transforma la dimensión del espaciotiempo d=4 en una variable compleja (con parte real y parte imaginaria), lo que permite esquivar los polos mediante una continuación analítica. Te puede parecer casi esquizofrénico pasar de ℝ4 a ℂ4 para evaluar una integral de Feynman, pero el método es sencillo de entender y de aplicar.

En los cálculos mediante regularización dimensional es habitual tomar como variable ε = d−4, es decir, trabajar en d=4−ε dimensiones. Se evalúa el resultado final libre de infinitos tras la regularización y se pone ε=0 para obtener el resultado final deseado. Este método es muy usado porque es muy fácil de incorporar en programas de ordenador de álgebra simbólica (Veltman desarrolló en 1963 el software Schoonschip e implementó en él el método a principios de los 1970, lo que lo hizo muy popular entre los físicos teóricos de la época). Pero tiene un grave problema de explosión combinatoria. En los cálculos intermedios aparecen muchos términos que dependen de ε, pero que en el resultado final desaparecen al hacer ε=0. ¿Se podría desarrollar un método similar que evite esta explosión combinatoria trabajando todo el tiempo con d=4? Hay varios métodos para lograrlo y la noticia de El Confidencial se hace eco del nuevo método desarrollado por el equipo liderado por el físico teórico Germán Rodrigo, investigador del CSIC en el Instituto de Física Corpuscular (IFC), Universitat de Valencia/Consejo Superior de Investigaciones Científicas.

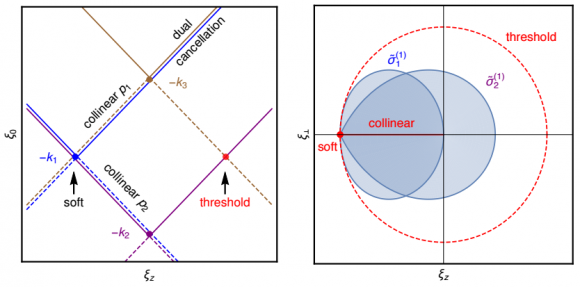

Entrar en detalles técnicos del nuevo método nos llevaría lejos. Resumiendo mucho, la idea es usar una dualidad entre los diagramas de Feynman con lazos (partículas virtuales) y diagramas sin lazos (tipo árbol, sin partículas virtuales), llamada LTD (Loop-Tree Duality). Esta dualidad transforma las partículas virtuales en los lazos en partículas (reales) a nivel de árbol. Para ello se transforma el espacio de momentos en un espacio de momentos dual en el que se pueden realizar los cálculos de las integrales de Feynman en d=4 dimensiones. Como resultado, se puede evitar usar la técnica de regularización dimensional y la explosión combinatoria asociada a los factores que dependen de ε = d−4.

La técnica es muy prometedora y permite lidiar tanto con divergencias ultravioletas como infrarrojas. Sin embargo, todavía está en fase de desarrollo. En los dos últimos años los autores sólo han podido evaluar diagramas hasta NNLO, cuando hoy en día la regularización dimensional se aplica hasta NNNLO. Además, sólo han estudiado en completo detalle un proceso físico de interés para el LHC, la evaluación a NNLO del diagrama γ* → qq(g), la desintegración de un fotón virtual en un par quark-antiquark y un gluón. Se requieren avances importantes para poder evaluar diagramas más complicados con esta técnica. Por ello, aún siendo optimistas, falta bastante tiempo para que esta nueva técnica de regularización logre sustituir a la regularización dimensional en los cálculos teóricos de las colisiones en el LHC (si es que lo logra algún día).

En resumen, si a mí me costó entender la noticia de El Confidencial, imagina al común de sus lectores. Espero haber aclarado un poco en que consiste el trabajo teórico desarrollado por el equipo de Rodrigo y cuál puede ser repercusión en la física de partículas.

Un poco exagerada la noticia de «El confidencial», pero aquí cabe recordar que el propio Freedman Dyson ha dicho que mucha de la fascinante historia de la QED consistió en encontrar métodos eficientes de cálculo(teoría de perturbaciones) y aprender a lidiar con divergencias.

No se debe subestimar esta clase de progreso, los diagramas de Feynman fueron uno de los grandes logros (operativos si se quiere pero logros al fin) de aquella época dorada de la física, ellos mismos son sugestivos para introducir técnicas de renormalización, en su momento ayudaron a Feynman a descubrir el concepto de «fantasma», cosas importantes.

Interesante enterarse de los algoritmos para hacer más eficiente la regularización dimensional.

Este artículo tiene un ejemplo pedagógico muy interesante de las ideas básicas de regularización dimensional: https://arxiv.org/pdf/0812.3578v1.pdf

Gracias Francis!